تغییر اساسی در اصول هوش مصنوعی گوگل

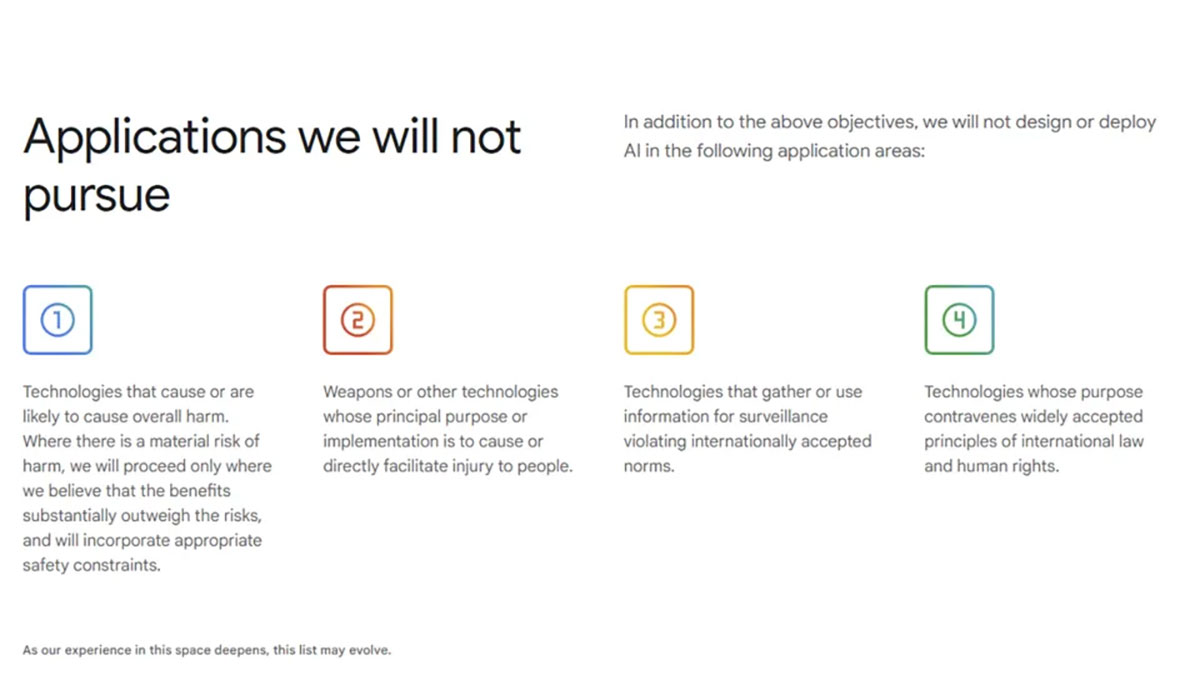

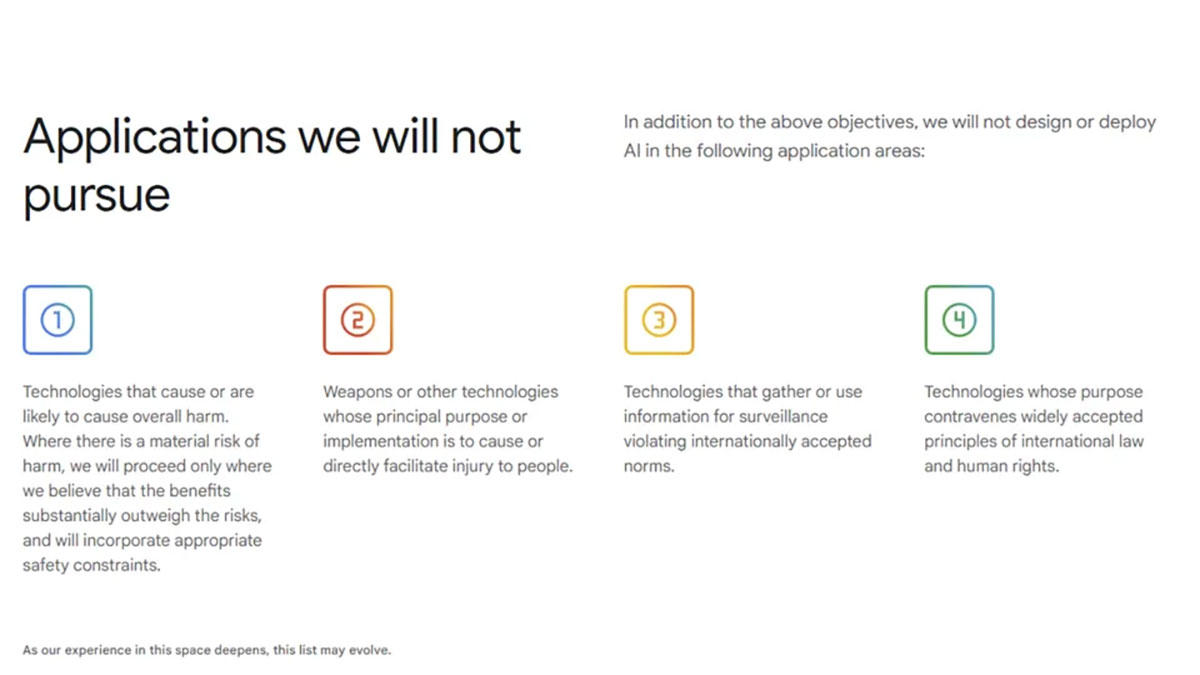

پیشتر، سند سیاستهای گوگل شامل بخشی با عنوان “کاربردهایی که دنبال نخواهیم کرد” بود. در این بخش، این شرکت تأکید کرده بود که هوش مصنوعی را برای استفاده در تسلیحات یا نظارتهای گسترده توسعه نخواهد داد. اما در نسخه جدید این سند، این تعهدات حذف شده و جای خود را به بخشی با عنوان “توسعه و پیادهسازی مسئولانه” دادهاند.

در این نسخه جدید، گوگل بر روی نظارت انسانی، بررسیهای دقیق و مکانیزمهای بازخورد برای همراستا کردن فناوریهای خود با اهداف کاربران، مسئولیت اجتماعی و قوانین بینالمللی تأکید دارد.

چرا این تغییر اتفاق افتاد؟

این تغییر در سیاستهای گوگل همزمان با گسترش نقش هوش مصنوعی در حوزههای امنیتی و نظامی رخ داده است. دمیس هسابیس، مدیرعامل DeepMind، و جیمز منیکا، معاون ارشد تحقیقاتی گوگل، در یک پست وبلاگی اعلام کردند که ظهور هوش مصنوعی بهعنوان یک فناوری عمومی مستلزم بازنگری در این سیاستها بوده است.

“ما بر این باوریم که دموکراسیها باید پیشگام توسعه هوش مصنوعی باشند، با هدایت ارزشهایی مانند آزادی، برابری و احترام به حقوق بشر. همچنین، شرکتها، دولتها و سازمانهایی که این ارزشها را به اشتراک میگذارند باید با یکدیگر همکاری کنند تا هوش مصنوعی در جهت حفاظت از مردم، رشد جهانی و امنیت ملی توسعه یابد.”

سابقه گوگل در همکاریهای نظامی

این تغییر سیاست در حالی اتفاق میافتد که گوگل پیشینهای بحثبرانگیز در همکاریهای نظامی دارد. در سال ۲۰۱۸، این شرکت به دلیل مشارکت در پروژه Maven که هدف آن استفاده از هوش مصنوعی برای تحلیل ویدئوهای پهپادی وزارت دفاع آمریکا بود، مورد اعتراض گسترده کارکنان خود قرار گرفت. دهها کارمند از کار استعفا دادند و هزاران نفر دیگر با امضای یک دادخواست، مخالفت خود را اعلام کردند.

maven project

با این حال، از سال ۲۰۲۱، گوگل دوباره به دنبال قراردادهای نظامی رفته است. این شرکت بهصورت تهاجمی برای قرارداد محاسبات ابری پنتاگون موسوم به JWCC پیشنهاد داد. علاوه بر این، گزارشهایی منتشر شده که نشان میدهد گوگل چندین بار با وزارت دفاع اسرائیل برای توسعه ابزارهای هوش مصنوعی همکاری کرده است.

جمعبندی

این تغییر در سیاستهای هوش مصنوعی گوگل نشان میدهد که موضع این شرکت در قبال استفاده نظامی از هوش مصنوعی نرمتر شده است. حذف تعهدات سابق در مورد عدم استفاده از هوش مصنوعی در تسلیحات و نظارت، میتواند زمینهساز همکاریهای بیشتر این شرکت با دولتها و نهادهای امنیتی در آینده باشد. با این وجود، همچنان نگرانیهایی درباره پیامدهای اخلاقی و انسانی این تغییرات وجود دارد.

نظر شما درباره استفاده از هوش مصنوعی در موارد نظامی چیست؟

بفرست برای دوستات

source